目录

摘要:

1.卷积神经网络介绍:

2.卷积神经网络(CNN)构建与训练:

2.1 CNN的输入图像

2.2 构建CNN网络

2.3 训练CNN网络

3.卷积神经网络(CNN)的实际分类测试:

4.本文Matlab实验代码:

摘要:

使用Matlab自带的深度学习工具箱构建卷积神经网络(CNN)进行图片分类,以识别并分类手写数字为例。首先将大量的图片数据导入;然后给不同种类的图片打上对应的分类的标签,划分为训练集和测试集;构建CNN网络其中包括3层2维卷积和3个池化层,全连接层及分类层;调整好输入输出格式对CNN进行训练及测试;最后结果表明CNN可以有效的对手写数字图像进行分类。代码已做标准化处理,使用者可通过替换数据实现自己需要的功能。

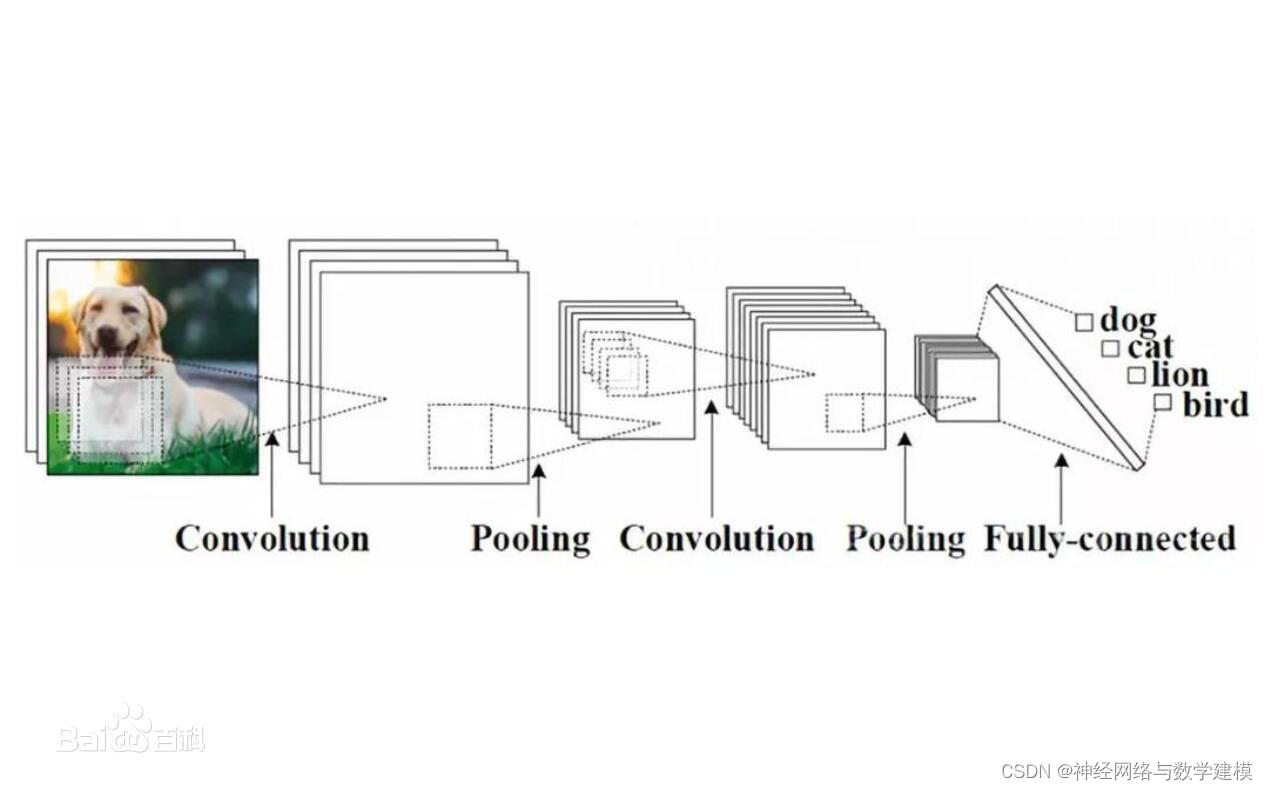

1.卷积神经网络介绍:

卷积神经网络 (Convolutional Neural Network,CNN) 这一概念最早由 Yann Lecun 于 20 世纪 80 年代提出,是受到生物神经学中感受野的启发而发展起来的一种前馈神经网络结构模型。其作为一种有监督深度学习算法,端到端的数据处理模式,由于特征提取阶段不需要人工选择,而被广泛应用在各个领域的设备状态监测中。

2.卷积神经网络(CNN)构建与训练:

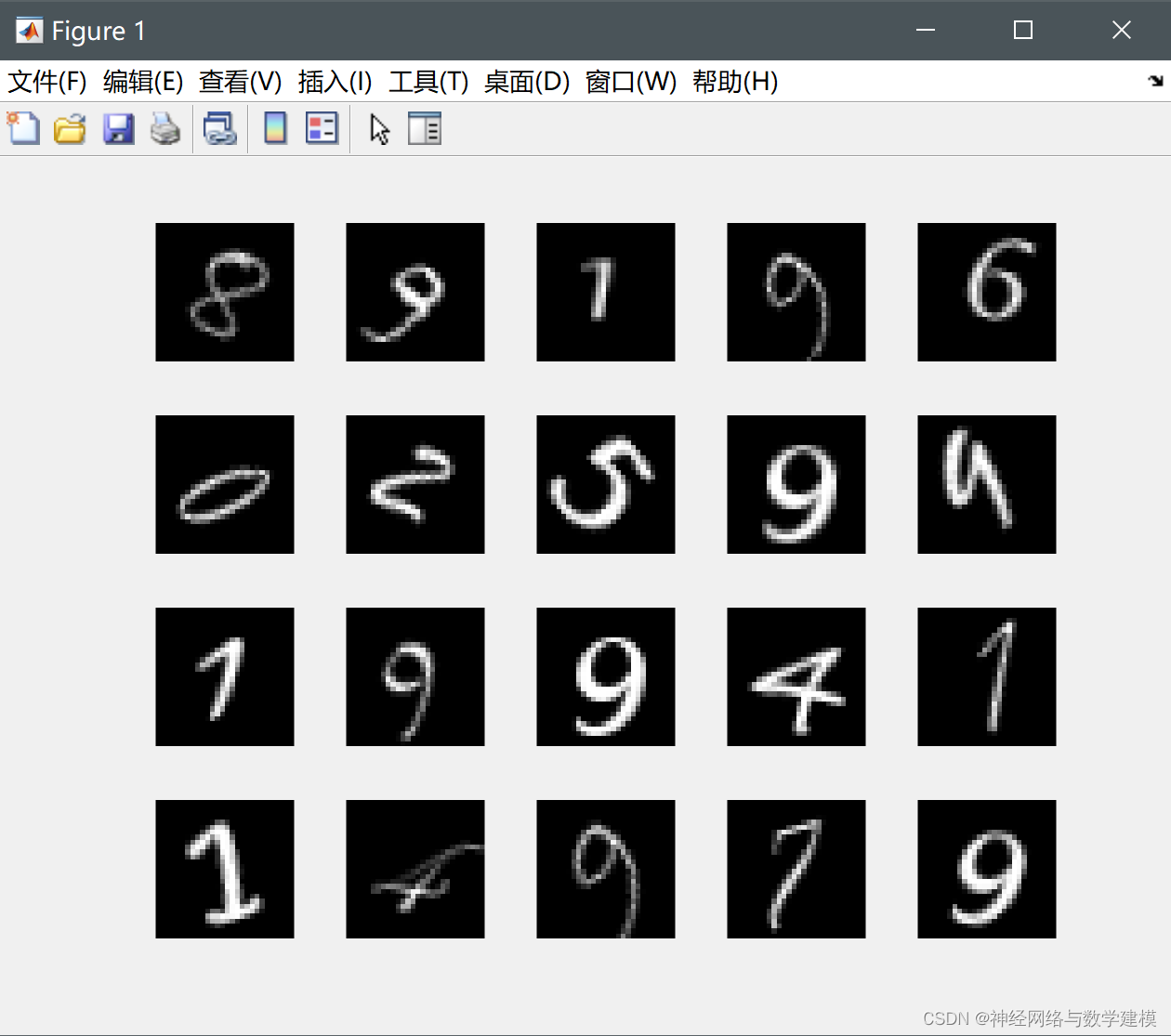

2.1 CNN的输入图像

本文CNN的输入图像如下:为1-9的手写数字,对应分类标签为1-9。

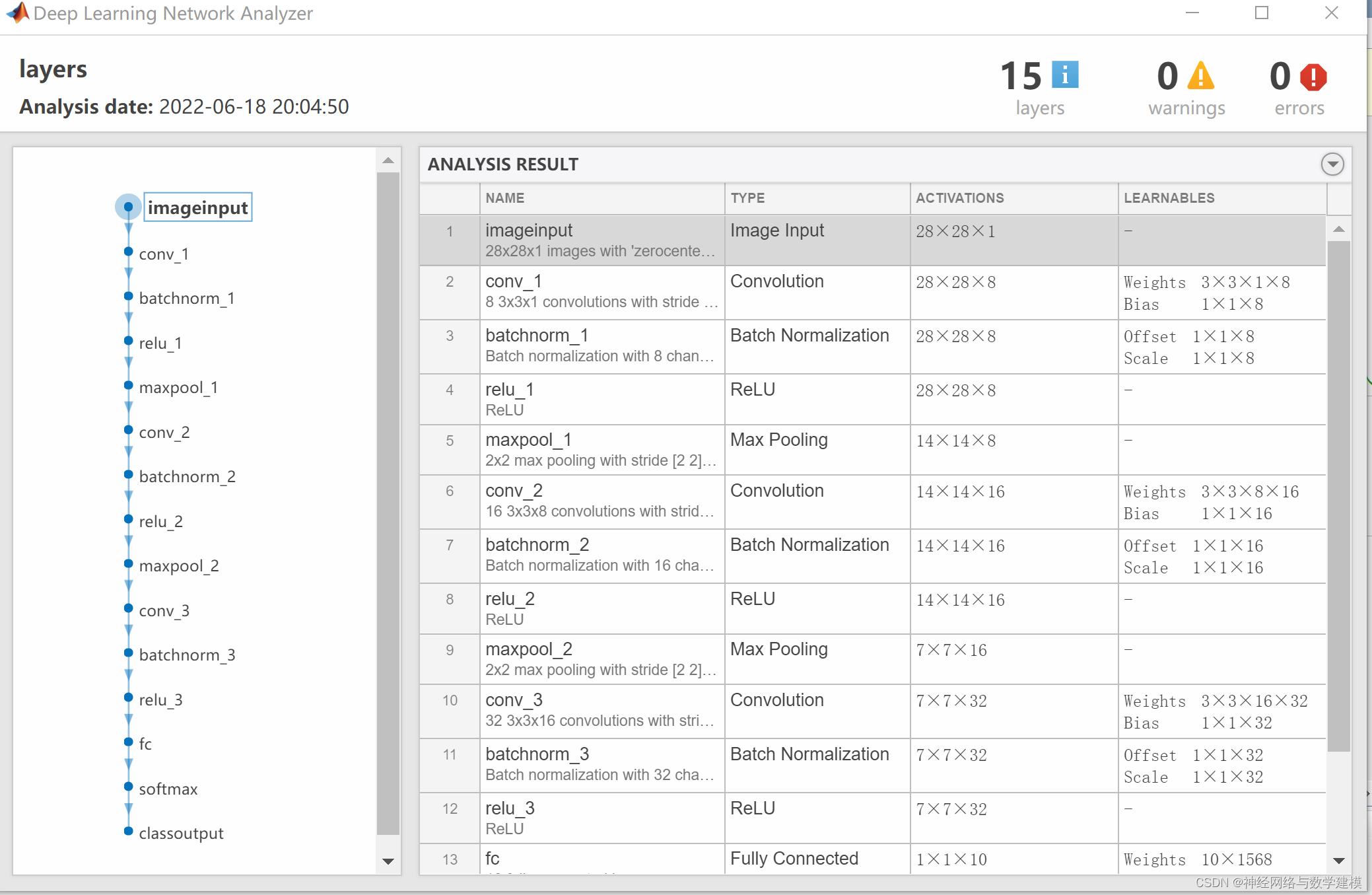

2.2 构建CNN网络

本文构建的CNN结构如下图所示:

- 图像输入层:用于指定图像大小,在本例中为 28×28×1。这些数字对应于高度、宽度和通道大小。数字数据由灰度图像组成,因此通道大小(颜色通道)为 1。对于彩色图像,通道大小为 3,对应于 RGB 值。

- 卷积层:在三层卷积层中,第一层有8个3*3的卷积核,第二层有16个3*3的卷积核,第三层有32个3*3的卷积核。卷积层逐渐加深,不断提取输入图像的特征。

- 批量归一化层批量归一化层对网络中的激活值和梯度传播进行归一化,使网络训练成为更简单的优化问题。在卷积层和非线性部分(例如 ReLU 层)之间使用批量归一化层,来加速网络训练并降低对网络初始化的敏感度。

- ReLU 层:批量归一化层后接一个非线性激活函数。最常见的激活函数是修正线性单元 (ReLU)。使用 reluLayer 创建 ReLU 层。

- 最大池化层:卷积层(带激活函数)有时会后跟下采样操作,以减小特征图的空间大小并删除冗余空间信息。通过下采样可以增加更深卷积层中的滤波器数量,而不会增加每层所需的计算量。下采样的一种方法是使用最大池化,在此示例中,该矩形区域的大小是2

- 全连接层:卷积层和下采样层后跟一个或多个全连接层。顾名思义,全连接层中的神经元将连接到前一层中的所有神经元。该层将先前层在图像中学习的所有特征组合在一起,以识别较大的模式。最后一个全连接层将特征组合在一起来对图像进行分类。因此,最后一个全连接层中的 OutputSize 参数等于目标数据中的类数。

- softmax 层: softmax 激活函数对全连接层的输出进行归一化。

- 分类层:最终层是分类层。该层使用 softmax 激活函数针对每个输入返回的概率,将输入分配到其中一个互斥类并计算损失。

2.3 训练CNN网络

定义网络结构体后,指定训练选项。使用具有动量的随机梯度下降 (SGDM) 训练网络,初始学习率为 0.01。将最大训练轮数设置为 4。将数据分为训练集和测试集,对构建好的CNN进行训练,训练过程中的误差曲线如下:

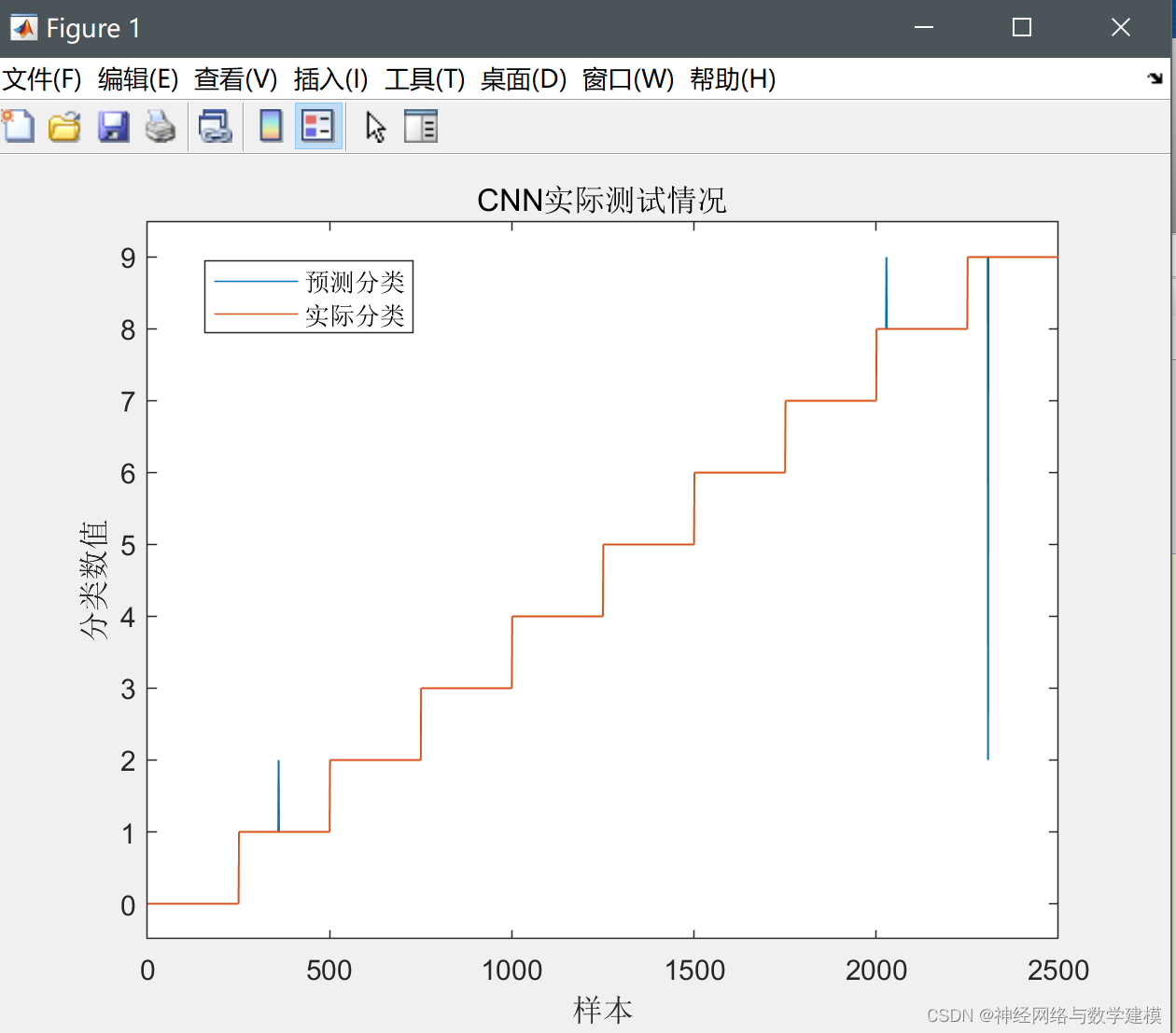

3.卷积神经网络(CNN)的实际分类测试:

使用经过训练的网络预测验证数据的标签,并计算最终验证准确度。准确度是网络预测正确的标签的比例。在本例中,超过 99% 的预测标签与验证集的真实标签相匹配。

文章来源:https://uudwc.com/A/Xjke

文章来源:https://uudwc.com/A/Xjke

文章来源地址https://uudwc.com/A/Xjke

文章来源地址https://uudwc.com/A/Xjke