环境描述:

hudi版本:0.13.1

flink版本:flink-1.15.2

spark版本:3.3.2

Hive版本:3.1.3

Hadoop版本:3.3.4

一.Flink集成Hive

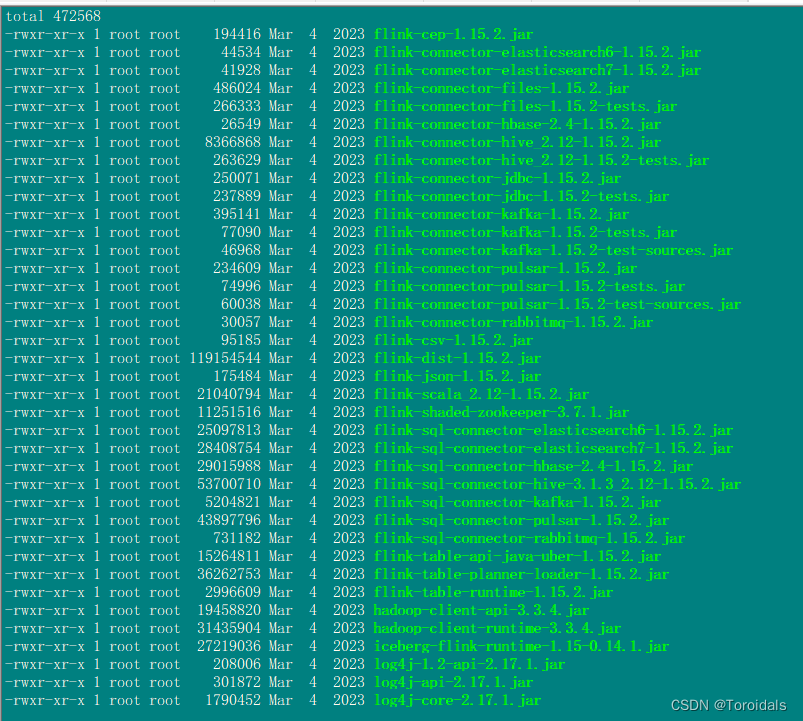

1.拷贝hadoop包到Flink lib目录

hadoop-client-api-3.3.4.jar

hadoop-client-runtime-3.3.4.jar

2.下载上传flink-hive的jar包

flink-connector-hive_2.12-1.15.2.jar

flink-sql-connector-hive-3.1.3_2.12-1.15.2.jar

3.复制hive-site.xml到flink conf下

方式一:复制文章来源:https://uudwc.com/A/Y6BRJ

方式二(推荐):创建软连接文章来源地址https://uudwc.com/A/Y6BRJ

ln