文章目录

- 前言

- 一、安全

- 二、隐私和道德

- 三、我们应该做什么

- 总结

前言

ChatGPT发展到目前,其实网上已经有大量资料了,博主做个收口,会出一个ChatGPT探索系列的文章,帮助大家深入了解ChatGPT的。整个系列文章会按照一下目标来完成:

- 理解ChatGPT的背景和应用领域;

- 学习GPT模型系列的发展历程和原理;

- 探究ChatGPT的训练、优化和应用方法;

- 分析ChatGPT在各领域的实际案例;

- 讨论人工智能伦理问题及ChatGPT的责任;

- 思考ChatGPT的未来发展趋势和挑战。

本次ChatGPT探索系列之一的主题是讨论人工智能伦理问题及ChatGPT的责任。众所周知,ChatGPT虽然暂时无法拥有自我意识或情感,但它可以通过不断学习来提高自己的能力和性能。与此同时,ChatGPT也面临着一系列伦理和社会问题,例如如何保护用户的隐私和安全、如何避免歧视和偏见、如何确保其回答准确和合适等等。因此,讨论人工智能伦理问题及ChatGPT的责任是至关重要的。

人类最伟大的两个驱动力,贪婪和好奇心,将推动人工智能的发展。我们唯一的希望是我们可以控制它。在这篇文章中,我们将深入讨论人工智能伦理问题及ChatGPT的责任,一起分析ChatGPT在安全、隐私和道德方面的影响。

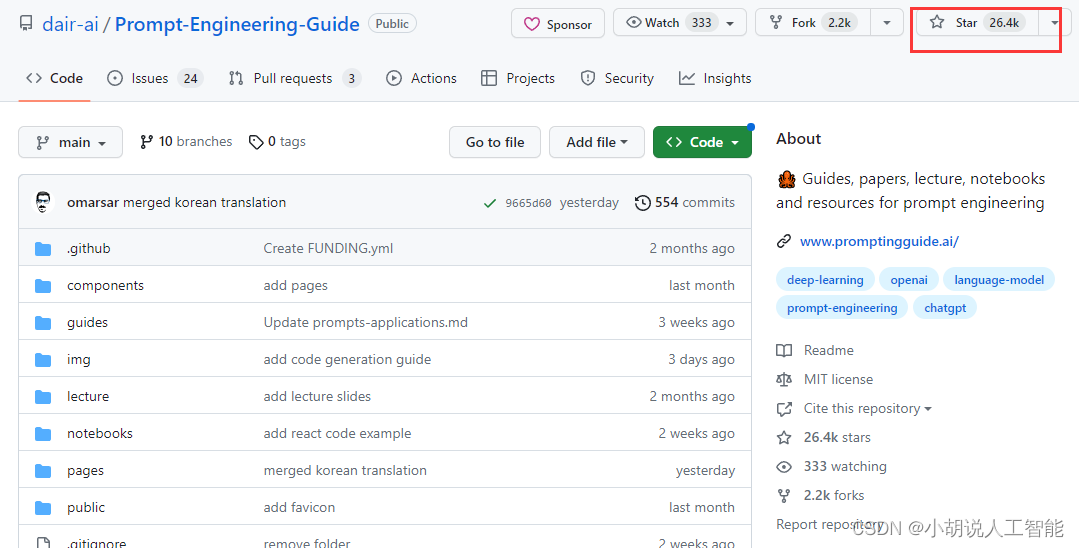

如果对ChatGPT相关资料感兴趣的同学,可以直接访问开源资料库:ChatGPT_Project

一、安全

在2023年3月16日接受美国广播公司新闻采访时,OpenAI联合创始人Altman被问及人工智能可能带来的最坏结果时,他提到了一系列潜在的问题,其中包括对大规模虚假信息的担忧。ChatGPT-3的一些功能展示了生成令人信服但虚假的信息的能力,这使得人们更加关注这一问题。此外,机器学习算法的准确代码生成能力也可能被滥用,用于调试和改进恶意软件,从而对计算机系统造成威胁。这些问题已经引起了研究人员的广泛关注和讨论。

对于AI技术而言,安全问题是一条双重道路,它可以被恶意行为者用来攻击受害者,同时它自身的安全性也容易被滥用。ChatGPT作为一种先进的AI技术,已经经历过至少一次违规行为。在2023年3月20日开始的一周内,OpenAI曾下线系统并修复用户信息暴露的漏洞,但后来发现其修复程序本身存在漏洞,并且ChatGPT API容易被绕过。因此,如何保障AI技术的安全性和可靠性已成为一个重要的课题。我们需要采取更多措施来确保AI技术的安全性和负责任性,并推动AI技术的可持续和良性发展。

二、隐私和道德

隐私问题是人工智能面临的最大挑战之一。道德或不道德的技术实施可能会推动隐私滥用的程度,这已引起了人们的广泛关注。IBM 首席隐私与信任官兼 AI 伦理委员会主席克里斯蒂娜·蒙哥马利在接受 SecurityWeek 采访时表示:“这项技术的发展速度显然快于社会围绕它建立合理护栏的能力,而且其他科技公司如何保护与其系统交互的数据隐私仍然不够透明。”

蒙哥马利强调了政府和行业的重要性,他们必须共同解决人工智能带来的挑战。政府需要加强监管,制定更为严格的AI应用控制和监管规定,而行业必须更加重视道德使用原则,特别是在消费者环境中。IBM 已经为AI的开发和使用制定了道德原则,包括将责任和道德放在首位。蒙哥马利指出,其他私营企业也应该加强这方面的努力,通过参与工作来增强人们对这项技术的信任。

然而,缺乏监管可能导致隐私侵犯行为的继续存在。一些大型科技公司收集大量数据的原因是为了获得培训数据,用于创建像 GPT4 这样的工具。这样的做法已经引起了人们对隐私风险的担忧。尽管存在一些适当的保护措施,但 ChatGPT 仍然存在一些缺点。因此,适当的监督变得更加重要,尤其是在消费者环境中。

消除偏见和提高培训质量也是重要的挑战之一。AI开发人员必须通过多样化、高质量的数据集和减少偏见的方法来改进培训过程。这是一个复杂的问题,因为它涉及到许多已经存在的、也许是无意识的偏见,需要开发人员在不断地努力中解决。

三、我们应该做什么

生命未来研究所在 2023 年 3 月 29 日发布了一封公开信,呼吁所有 AI 实验室立即暂停至少 6 个月的时间来训练比 GPT-4 更强大的 AI 系统。这封信引用了 Asilomar AI 原则,这是一个公认的 AI 治理原则清单,其中包括了需要关注和规划先进 AI 带来的深刻变化的条款。尽管这封信引起了广泛的讨论和反响,但在安全行业内部对此的反应却不尽相同。我在当时也写了一篇分析文章:预测“叫停GPT-4后续AI大模型”后续:这是一个囚徒困境

有些人认为这封信不会有太大的成就,因为这些模型的发展受到金钱和时间的限制。他们主张应该让企业做好安全可靠地使用这些模型的准备,而不是试图阻止它们的发展。但也有人支持暂停人工智能的发展,不仅是出于商业和隐私方面的考虑,还有出于安全和完整性的考虑。他们认为在了解如何评估数据隐私、模型完整性和对抗性数据的影响之前,人工智能的持续发展可能会导致未预期的社会、技术和网络后果。

无论如何,我们不能阻止人工智能的持续发展。人工智能已经成为了人类最伟大的两个驱动力之一,贪婪和好奇心的体现。我们的唯一希望是通过控制人工智能的使用和开发来最大程度地发挥它的潜力。尽管精灵已经从瓶子里出来,但我们可以努力让它为人类的利益所用,而不是为我们的伤害和损失服务。

总结

本文是ChatGPT探索系列之一,主题是讨论人工智能伦理问题及ChatGPT的责任。文章探讨了ChatGPT在安全、隐私和道德方面的影响,并指出了人工智能领域所面临的最大挑战之一——隐私问题。为了应对这些问题,需要采取更多措施来确保AI技术的安全性和负责任性,并推动AI技术的可持续和良性发展。文章还呼吁政府和行业加强监管和道德使用原则的制定,以确保人工智能的良性发展。文章来源:https://uudwc.com/A/gk00o

最后,文章强调了控制人工智能的使用和开发来最大程度地发挥其潜力的重要性。尽管精灵已经从瓶子里出来,但我们可以努力让它为人类的利益所用,而不是为我们的伤害和损失服务。文章来源地址https://uudwc.com/A/gk00o